Vuoi individuare un deepfake? Gli occhi potrebbero essere una pista.

Indizi sui deepfakes potrebbero essere negli occhi.

Ricercatori dell'Università di Hull in Inghilterra hanno riportato il 15 luglio che i riflessi negli occhi offrono un modo potenziale per individuare immagini generate dall'intelligenza artificiale di persone. L'approccio si basa su una tecnica anche utilizzata dagli astronomi per studiare le galassie.

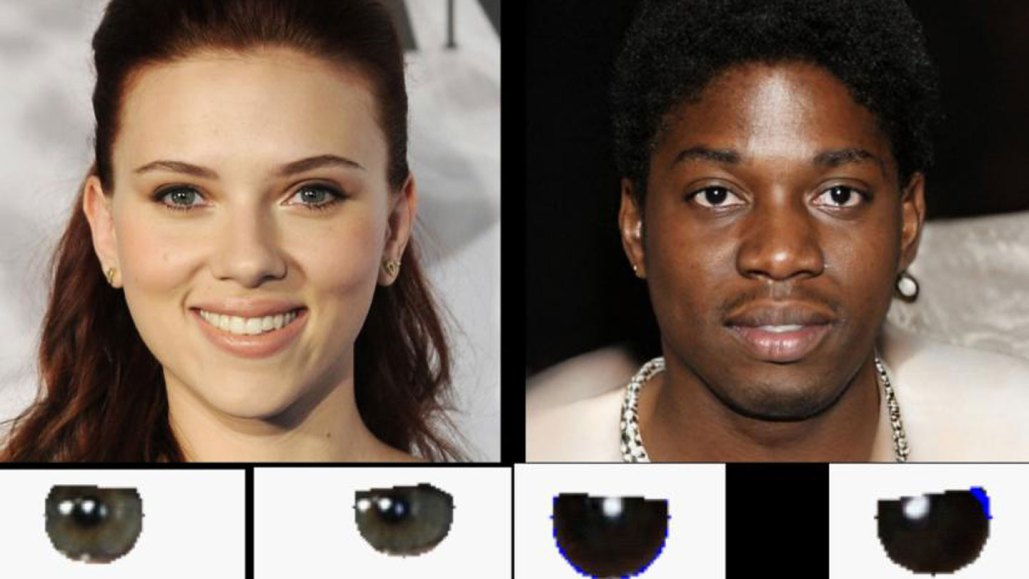

Nelle immagini reali, i riflessi luminosi negli occhi coincidono, mostrando, ad esempio, lo stesso numero di finestre o luci al soffitto. Ma nelle immagini false, spesso c'è un'incoerenza nei riflessi. "La fisica è sbagliata", dice Kevin Pimbblet, un astronomo osservativo che ha lavorato alla ricerca con la all'epoca studentessa laureata Adejumoke Owolabi e ha presentato i risultati al National Astronomy Meeting della Royal Astronomical Society a Hull.

Per effettuare i confronti, il team ha prima utilizzato un programma informatico per rilevare i riflessi e poi ha utilizzato i valori dei pixel di quei riflessi, che rappresentano l'intensità della luce in un determinato pixel, per calcolare ciò che viene chiamato indice di Gini. Gli astronomi utilizzano l'indice di Gini, originariamente sviluppato per misurare l'ineguaglianza della ricchezza in una società, per comprendere come la luce è distribuita in un'immagine di una galassia. Se un pixel ha tutta la luce, l'indice è 1; se la luce è distribuita uniformemente tra i pixel, l'indice è 0. Questa quantificazione aiuta gli astronomi a classificare le galassie in categorie come spirali o ellittiche.

Nel lavoro attuale, la differenza nei valori di Gini tra gli occhi sinistro e destro è l'indizio dell'autenticità dell'immagine. Per circa il 70 percento delle immagini false esaminate dai ricercatori, questa differenza era molto maggiore rispetto alla differenza per le immagini reali. Nelle immagini reali, tendeva a non esserci differenza, o a esserci una differenza molto piccola.

"Non possiamo dire che un valore particolare corrisponda alla falsificazione, ma possiamo dire che è indicativo di un problema, e forse un essere umano dovrebbe dare un'occhiata più ravvicinata", dice Pimbblet.

Egli sottolinea che la tecnica, che potrebbe funzionare anche su video, non è una soluzione miracolosa per individuare le contraffazioni. Ad esempio, un'immagine reale può sembrare falsa se la persona sta sbattendo le palpebre o se è così vicina alla fonte luminosa che solo un occhio mostra il riflesso. Ma la tecnica potrebbe essere parte di una serie di test, almeno finché l'IA non impari a ottenere i riflessi correttamente.