Envie de repérer un deepfake? Les yeux pourraient être révélateurs

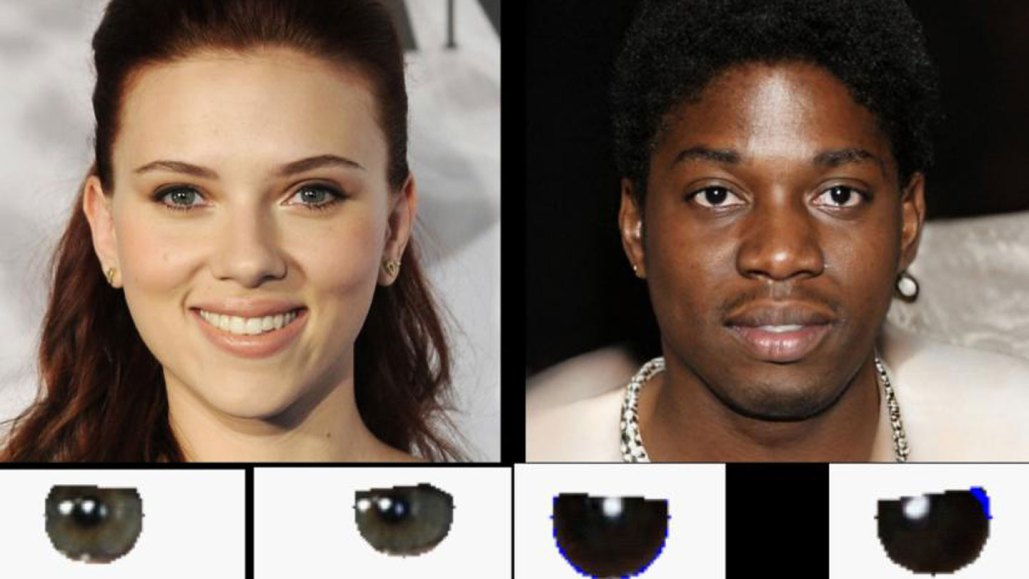

Des indices sur les deepfakes peuvent se trouver dans les yeux.

Des chercheurs de l'Université de Hull en Angleterre ont rapporté le 15 juillet que les reflets dans les yeux offrent un moyen potentiel de repérer les images de personnes générées par l'IA. Cette approche repose sur une technique également utilisée par les astronomes pour étudier les galaxies.

Dans les images réelles, les reflets de lumière dans les pupilles correspondent, montrant, par exemple, le même nombre de fenêtres ou de plafonniers. Mais dans les images fausses, il y a souvent une incohérence dans les reflets. "La physique est incorrecte", explique Kevin Pimbblet, un astronome observationnel qui a travaillé sur la recherche avec l'étudiante diplômée de l'époque, Adejumoke Owolabi, et a présenté les résultats lors de la réunion nationale de la Royal Astronomical Society à Hull.

Pour effectuer les comparaisons, l'équipe a d'abord utilisé un programme informatique pour détecter les reflets, puis a utilisé les valeurs de pixels de ces reflets, qui représentent l'intensité de la lumière à un pixel donné, pour calculer ce qu'on appelle l'indice de Gini. Les astronomes utilisent l'indice de Gini, initialement développé pour mesurer l'inégalité des richesses dans une société, pour comprendre comment la lumière est répartie à travers une image d'une galaxie. Si un pixel a toute la lumière, l'indice est de 1 ; si la lumière est uniformément répartie à travers les pixels, l'indice est de 0. Cette quantification aide les astronomes à classer les galaxies en catégories telles que spirale ou elliptique.

Dans le travail actuel, la différence dans les indices de Gini entre les pupilles gauche et droite est l'indice de l'authenticité de l'image. Pour environ 70 pour cent des images fausses examinées par les chercheurs, cette différence était beaucoup plus grande que la différence pour les images réelles. Dans les images réelles, il y avait tendance à ne pas avoir de différence, ou une très faible différence.

"Nous ne pouvons pas dire qu'une valeur particulière correspond à un faux, mais nous pouvons dire que cela indique qu'il y a un problème, et peut-être qu'un être humain devrait examiner de plus près", souligne Pimbblet.

Il souligne que la technique, qui pourrait également fonctionner sur des vidéos, n'est pas une solution miracle pour détecter la contrefaçon. Une image réelle peut ressembler à une fausse, par exemple, si la personne cligne des yeux ou si elle est si proche de la source de lumière que seul un œil montre le reflet. Mais la technique pourrait faire partie d'une batterie de tests - du moins jusqu'à ce que l'IA apprenne à bien reproduire les reflets.