Chcesz zidentyfikować deepfake'a? Oczy mogą być kluczem

Wskazówki dotyczące deepfake’ów mogą znajdować się w oczach.

Naukowcy z University of Hull w Anglii poinformowali 15 lipca, że odbicia w oczach oferują potencjalny sposób na rozszyfrowanie obrazów ludzi generowanych przez AI. Podejście to opiera się na technice stosowanej również przez astronomów do badania galaktyk.

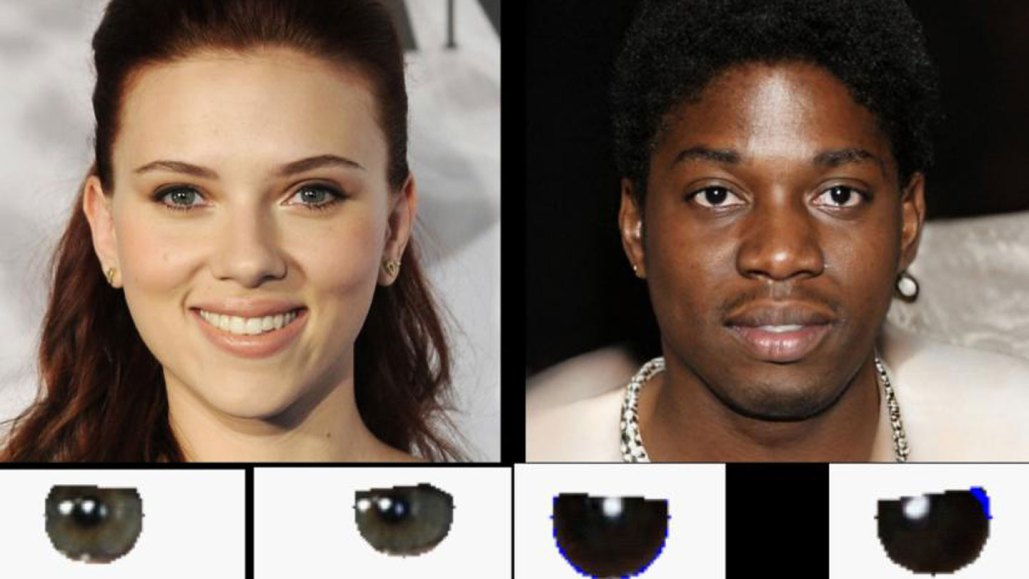

Na rzeczywistych obrazach odbicia światła w gałkach ocznych pasują do siebie, pokazując na przykład taką samą liczbę okien lub lamp sufitowych. Jednak na fałszywych obrazach odbicia często są niespójne. „Fizyka jest niepoprawna” — mówi Kevin Pimbblet, astronom obserwacyjny, który pracował nad badaniami z ówczesnym studentem studiów podyplomowych Adejumoke Owolabi i przedstawił wyniki na Narodowym Spotkaniu Astronomicznym Królewskiego Towarzystwa Astronomicznego w Hull.

Aby przeprowadzić porównania, zespół najpierw użył programu komputerowego do wykrycia odbić, a następnie wykorzystał wartości pikseli tych odbić, które reprezentują intensywność światła w danym pikselu, do obliczenia tego, co nazywa się współczynnikiem Giniego. Astronomowie wykorzystują indeks Giniego, pierwotnie opracowany do pomiaru nierówności majątkowych w społeczeństwie, aby zrozumieć, jak światło jest rozłożone na obrazie galaktyki. Jeśli jeden piksel ma całe światło, indeks wynosi 1; jeśli światło jest równomiernie rozłożone na pikselach, indeks wynosi 0. Ta kwantyfikacja pomaga astronomom klasyfikować galaktyki do kategorii, takich jak spiralne lub eliptyczne.

W obecnej pracy różnica w indeksach Giniego między lewą i prawą gałką oczną jest kluczem do autentyczności obrazu. W przypadku około 70 procent fałszywych obrazów, które badali naukowcy, różnica ta była znacznie większa niż różnica w przypadku prawdziwych obrazów. W przypadku prawdziwych obrazów różnica miała tendencję do braku lub prawie braku różnicy.

„Nie możemy powiedzieć, że konkretna wartość odpowiada fałszerstwu, ale możemy powiedzieć, że wskazuje na istnienie problemu, a być może człowiek powinien przyjrzeć się temu bliżej” — mówi Pimbblet.

Podkreśla, że technika, która może również działać na filmach, nie jest cudownym środkiem do wykrywania fałszerstw. Prawdziwy obraz może wyglądać jak fałszywy, na przykład, jeśli osoba mruga lub jest tak blisko źródła światła, że odbicie widać tylko w jednym oku. Jednak technika ta mogłaby być częścią serii testów — przynajmniej do czasu, aż AI nauczy się prawidłowo rozpoznawać odbicia.