Dovremmo utilizzare l'IA per resuscitare i 'fantasmi' digitali dei morti?

Quando si sente la mancanza di un caro che è passato a miglior vita, si potrebbe guardare vecchie foto o ascoltare vecchie segreterie telefoniche. Ora, con la tecnologia dell'intelligenza artificiale, è possibile anche parlare con un bot virtuale creato per sembrare e suonare esattamente come loro.

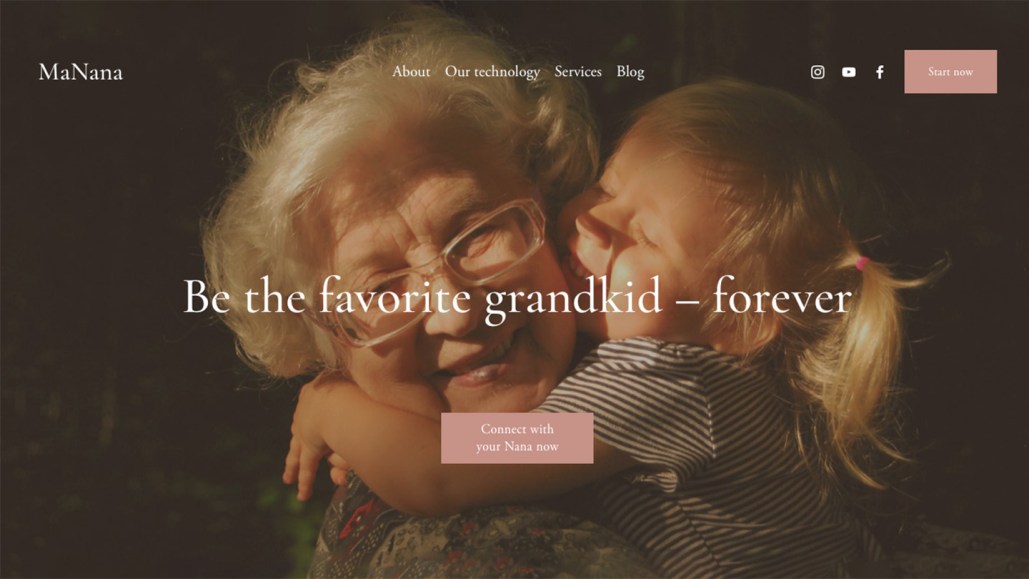

Le aziende Silicon Intelligence e Super Brain offrono già questo servizio. Entrambe si affidano all'IA generativa, inclusi grandi modelli di linguaggio simili a quello alla base di ChatGPT, per setacciare frammenti di testo, foto, registrazioni audio, video e altri dati. Utilizzano queste informazioni per creare "fantasmi" digitali dei morti per visitare i vivi.

Chiamati griefbot, deadbot o servizi di ricreazione, queste repliche digitali dei defunti "creano l'illusione che una persona morta sia ancora viva e possa interagire con il mondo come se nulla fosse realmente successo, come se la morte non fosse sopraggiunta", afferma Katarzyna Nowaczyk-Basińska, ricercatrice presso il Leverhulme Centre for the Future of Intelligence dell'Università di Cambridge che studia come la tecnologia modella le esperienze delle persone di morte, perdita e dolore.

Lei e il collega Tomasz Hollanek, etico della tecnologia presso la stessa università, hanno recentemente esplorato i rischi della tecnologia che consente una sorta di "immortalità digitale" in un articolo pubblicato il 9 maggio in Philosophy & Technology. L'IA potrebbe mettere in pericolo il rispetto per la dignità umana? Per fare chiarezza su questo, Science News ha parlato con Nowaczyk-Basińska. Questa intervista è stata modificata per lunghezza e chiarezza.

SN: La serie TV Black Mirror ha trasmesso un episodio agghiacciante nel 2013 su una donna che si procura un robot che imita il suo fidanzato morto. Quanto è realistica quella storia?

Nowaczyk-Basińska: Siamo già qui, senza il corpo. Ma sicuramente la resurrezione digitale basata su una grande quantità di dati - questa è la nostra realtà.

Nella mia relativamente breve carriera accademica, ho assistito a un notevole cambiamento dal punto in cui le tecnologie di immortalità digitale erano considerate una nicchia molto marginale, al punto in cui abbiamo il termine "industria della vita dopo la morte digitale". Da ricercatrice, lo trovo affascinante. Come persona, può essere molto spaventoso e preoccupante.

Utilizziamo scenari speculativi e finzione di design come metodo di ricerca. Ma non ci riferiamo a un futuro lontano. Invece, speculiamo su ciò che è tecnologicamente e socialmente possibile qui e ora.

SN: Il tuo articolo presenta tre scenari immaginari, ma problematici, che potrebbero sorgere con questi deadbot. Quale trovi personalmente più distopico?

Nowaczyk-Basińska: [In uno dei nostri scenari], presentiamo una donna malata terminale che lascia un griefbot per aiutare suo figlio di otto anni nel processo di lutto. Utilizziamo questo esempio perché pensiamo che esporre i bambini a questa tecnologia possa essere molto rischioso.

Penso che potremmo andare ancora oltre e usare questo ... nel prossimo futuro per mascherare anche il fatto della morte di un genitore o di un altro parente significativo a un bambino. E al momento, sappiamo molto, molto poco su come queste tecnologie influenzerebbero i bambini.

Sosteniamo che se non possiamo dimostrare che questa tecnologia non sarà dannosa, dovremmo adottare tutte le misure possibili per proteggere i più vulnerabili. E in questo caso, significherebbe limitare l'accesso a queste tecnologie in base all'età.

SN: Quali altre salvaguardie sono importanti?

Nowaczyk-Basińska: Dovremmo assicurarci che l'utente sia consapevole... che sta interagendo con l'IA. [La tecnologia può] simulare schemi di linguaggio e tratti della personalità basati sull'elaborazione di enormi quantità di dati personali. Ma sicuramente non è un'entità cosciente. Advocate anche per lo sviluppo di procedure sensibili per ritirare o eliminare i deadbot. E sottolineiamo anche l'importanza del consenso.

SN: Potresti descrivere lo scenario che hai immaginato che esplora il consenso per l'utente del bot?

Nowaczyk-Basińska: Presentiamo una persona anziana che segretamente - è una parola molto importante, segretamente - si impegna in un deadbot di se stessa, pagando per un abbonamento di 20 anni, sperando che ciò sarà di conforto ai suoi figli adulti. E ora immagina solo che dopo il funerale, i figli ricevano una serie di email, notifiche o aggiornamenti dal servizio di ricreazione, insieme all'invito a interagire con il bot del loro defunto padre.

[I figli] dovrebbero avere il diritto di decidere se vogliono passare attraverso il processo di lutto in questo modo o no. Per alcune persone, potrebbe essere confortante e potrebbe essere utile, ma per altre no.

SN: Argomenti anche che è importante proteggere la dignità degli esseri umani, anche dopo la morte. Nel tuo scenario immaginato su questo tema, una donna adulta utilizza un servizio gratuito per creare un deadbot della sua nonna morta da tempo. Cosa succede dopo?

Nowaczyk-Basińska: She asks the deadbot about the recipe for homemade carbonara spaghetti that she loved cooking with her grandmother. Instead of receiving the recipe, she receives a recommendation to order that food from a popular delivery service. Our concern is that griefbots might become a new space for a very sneaky product placement, encroaching upon the dignity of the deceased and disrespecting their memory.

SN: Different cultures have very different ways of handling death. How can safeguards take this into account?

Nowaczyk-Basińska: We are very much aware that there is no universal ethical framework that could be developed here. The topics of death, grief and immortality are hugely culturally sensitive. And solutions that might be enthusiastically adopted in one cultural context could be completely dismissed in another. This year, I started a new research project: I’m aiming to explore different perceptions of AI-enabled simulation of death in three different eastern nations, including Poland, India and probably China.

SN: Why is now the time to act on this?

Nowaczyk-Basińska: When we started working on this paper a year ago, we were a bit concerned whether it’s too [much like] science fiction. Now [it’s] 2024. And with the advent of large language models, especially ChatGPT, these technologies are more accessible. That’s why we so desperately need regulations and safeguards.

Re-creation service providers today are making totally arbitrary decisions of what is acceptable or not. And it’s a bit risky to let commercial entities decide how our digital death and digital immortality should be shaped. People who decide to use digital technologies in end-of-life situations are already in a very, very difficult point in their lives. We shouldn’t make it harder for them through irresponsible technology design.