Devrions-nous utiliser l'IA pour ressusciter les 'fantômes' numériques des morts ?

Lorsque vous perdez un être cher qui est décédé, vous pouvez regarder de vieilles photos ou écouter de vieux messages vocaux. Aujourd'hui, grâce à la technologie de l'intelligence artificielle, vous pouvez également parler à un bot virtuel conçu pour ressembler et sonner comme eux.

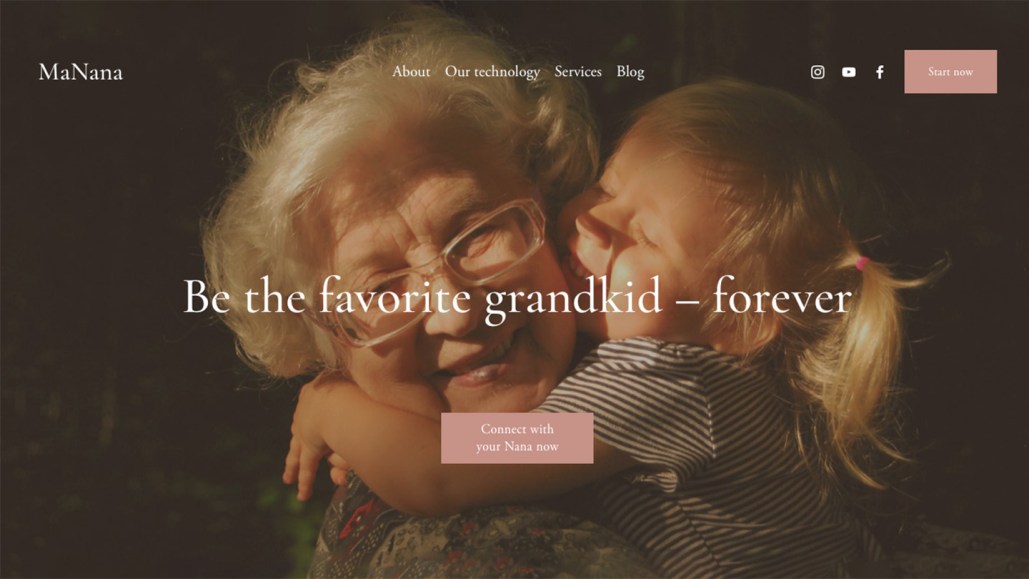

Les entreprises Silicon Intelligence et Super Brain proposent déjà ce service. Toutes deux s'appuient sur l'IA générative, y compris de grands modèles de langage similaires à celui derrière ChatGPT, pour passer au crible des morceaux de texte, des photos, des enregistrements audio, des vidéos et d'autres données. Ils utilisent cette information pour créer des "fantômes" numériques des morts pour rendre visite aux vivants.

Appelées griefbots, deadbots ou services de re-création, ces répliques numériques des défunts "créent l'illusion qu'une personne décédée est toujours vivante et peut interagir avec le monde comme si rien ne s'était réellement passé, comme si la mort ne s'était pas produite", déclare Katarzyna Nowaczyk-Basińska, chercheuse au Leverhulme Centre for the Future of Intelligence à l'Université de Cambridge qui étudie comment la technologie façonne les expériences des individus en matière de mort, de perte et de deuil.

Elle et son collègue Tomasz Hollanek, éthicien de la technologie à la même université, ont récemment exploré les risques de la technologie qui permet une sorte "d'immortalité numérique" dans un document publié le 9 mai dans Philosophy & Technology. La technologie de l'IA pourrait-elle prendre de l'avance sur le respect de la dignité humaine? Pour répondre à cette question, Science News s'est entretenu avec Nowaczyk-Basińska. Cet entretien a été édité pour plus de concision et de clarté.

SN: L'émission de télévision Black Mirror a diffusé un épisode glaçant en 2013 sur une femme qui obtient un robot qui mime son petit ami décédé. À quel point cette histoire est-elle réaliste?

Nowaczyk-Basińska: Nous y sommes déjà, sans le corps. Mais la résurrection numérique basée sur une énorme quantité de données, c'est notre réalité.

Au cours de ma relativement courte carrière universitaire, j'ai observé un changement significatif du point où les technologies d'immortalité numérique étaient perçues comme une niche très marginale, à celui où nous avons le terme "industrie de l'au-delà numérique". Pour moi en tant que chercheuse, c'est fascinant. En tant que personne, cela peut être très effrayant et inquiétant.

Nous utilisons des scénarios spéculatifs et du design fiction comme méthode de recherche. Mais nous ne faisons pas référence à un futur lointain. Au contraire, nous spéculons sur ce qui est technologiquement et socialement possible ici et maintenant.

SN: Votre document présente trois scénarios imaginaires, mais problématiques qui pourraient survenir avec ces deadbots. Lequel trouvez-vous personnellement plus dystopique?

Nowaczyk-Basińska: [Dans l'un de nos scénarios], nous présentons une femme gravement malade laissant un griefbot pour aider son fils de huit ans à gérer le processus de deuil. Nous utilisons cet exemple parce que nous pensons que l'exposition des enfants à cette technologie pourrait être très risquée.

Je pense que nous pourrions aller encore plus loin et utiliser cela … dans un futur proche pour dissimuler même le fait de la mort d'un parent ou d'un autre proche à un enfant. Et pour le moment, nous savons très, très peu de choses sur la façon dont ces technologies influenceraient les enfants.

Nous soutenons que si nous ne pouvons pas prouver que cette technologie ne sera pas nocive, nous devrions prendre toutes les mesures possibles pour protéger les plus vulnérables. Et dans ce cas, cela signifierait un accès limité à ces technologies en fonction de l'âge.

SN: Quelles autres protections sont importantes?

Nowaczyk-Basińska: Nous devrions nous assurer que l'utilisateur est conscient … qu'il interagit avec l'IA. [La technologie peut] simuler des schémas de langage et des traits de personnalité basés sur le traitement de grandes quantités de données personnelles. Mais ce n'est certainement pas une entité consciente. Nous plaçons également au avant une procédures sensibles de retraite ou de suppression des deadbots. Et nous soulignons également l'importance du consentement.

SN: Pouvez-vous décrire le scénario que vous avez imaginé qui explore le consentement pour l'utilisateur du bot?

Nowaczyk-Basińska: Nous présentons une personne âgée qui a secrètement— c'est un mot très important, secrètement — souscrit à un deadbot d'elle-même, en payant pour un abonnement de 20 ans, en espérant que cela réconfortera ses enfants adultes. Et maintenant, imaginez qu'après l'enterrement, les enfants reçoivent une série d'e-mails, de notifications ou de mises à jour du service de re-création, accompagnés de l'invitation à interagir avec le bot de leur père décédé.

[Les enfants] devraient avoir le droit de décider s'ils veulent traverser le processus de deuil de cette façon ou non. Pour certaines personnes, cela pourrait être réconfortant, et cela pourrait être utile, mais pas pour d'autres.

SN: Vous soutenez également qu'il est important de protéger la dignité des êtres humains, même après la mort. Dans votre scénario imaginé à ce sujet, une femme adulte utilise un service gratuit pour créer un deadbot de sa grand-mère décédée depuis longtemps. Que se passe-t-il ensuite?

Nowaczyk-Basińska: She asks the deadbot about the recipe for homemade carbonara spaghetti that she loved cooking with her grandmother. Instead of receiving the recipe, she receives a recommendation to order that food from a popular delivery service. Our concern is that griefbots might become a new space for a very sneaky product placement, encroaching upon the dignity of the deceased and disrespecting their memory.

SN: Different cultures have very different ways of handling death. How can safeguards take this into account?

Nowaczyk-Basińska: We are very much aware that there is no universal ethical framework that could be developed here. The topics of death, grief and immortality are hugely culturally sensitive. And solutions that might be enthusiastically adopted in one cultural context could be completely dismissed in another. This year, I started a new research project: I’m aiming to explore different perceptions of AI-enabled simulation of death in three different eastern nations, including Poland, India and probably China.

SN: Why is now the time to act on this?

Nowaczyk-Basińska: When we started working on this paper a year ago, we were a bit concerned whether it’s too [much like] science fiction. Now [it’s] 2024. And with the advent of large language models, especially ChatGPT, these technologies are more accessible. That’s why we so desperately need regulations and safeguards.

Re-creation service providers today are making totally arbitrary decisions of what is acceptable or not. And it’s a bit risky to let commercial entities decide how our digital death and digital immortality should be shaped. People who decide to use digital technologies in end-of-life situations are already in a very, very difficult point in their lives. We shouldn’t make it harder for them through irresponsible technology design.