Bör vi använda AI för att återuppväcka digitala 'spöken' av de döda?

När du saknar en älskad som har gått bort kan du titta på gamla foton eller lyssna på gamla röstmeddelanden. Nu kan du också prata med en virtuell bot som är gjord för att se ut och låta precis som dem, tack vare artificiell intelligens-teknologi.

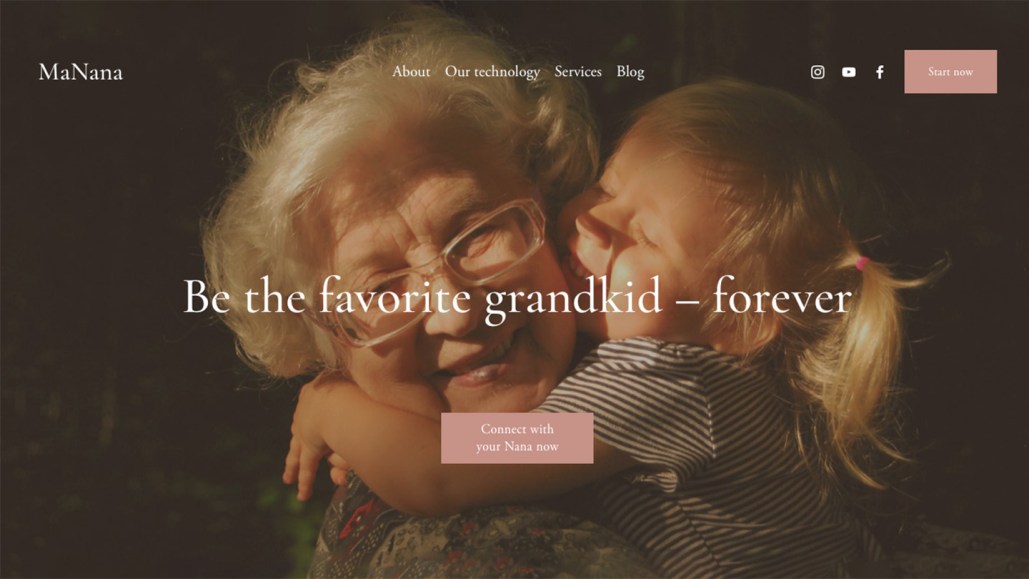

Företagen Silicon Intelligence och Super Brain erbjuder redan denna tjänst. Båda förlitar sig på generativ AI, inklusive stora språkmodeller liknande den som ligger bakom ChatGPT, för att gå igenom bitar av text, foton, ljudinspelningar, video och annan data. De använder denna information för att skapa digitala "spöken" av de döda att besöka de levande.

Dessa digitala repliker av de avlidna kallas för sorgebotar, dödsbotar eller återskapningstjänster och skapar "en illusion att en död person fortfarande är vid liv och kan interagera med världen som om ingenting faktiskt hände, som om döden inte inträffade", säger Katarzyna Nowaczyk-Basińska, en forskare vid Leverhulme Centre for the Future of Intelligence vid University of Cambridge som studerar hur teknologi formar människors upplevelser av död, förlust och sorg.

Hon och kollegan Tomasz Hollanek, en teknologi-etiker vid samma universitet, utforskade nyligen riskerna med teknik som tillåter en form av "digital odödlighet" i en artikel publicerad den 9 maj i Philosophy & Technology. Kan AI-teknologi springa före respekten för mänsklig värdighet? För att få grepp om detta, talade Science News med Nowaczyk-Basińska. Denna intervju har redigerats för längd och klarhet.

SN: TV-showen Black Mirror körde ett kusligt avsnitt 2013 om en kvinna som får en robot som härmar hennes döde pojkvän. Hur realistisk är den historien?

Nowaczyk-Basińska: Vi är redan här, utan kroppen. Men visst är digital återupplivning baserad på en stor mängd data - det är vår verklighet.

Under min relativt korta akademiska karriär har jag bevittnat en betydande förskjutning från den punkt där teknik för digital odödlighet betraktades som en mycket marginaliserad nisch, till den punkt där vi [har] termen "digital efterlifesindustri". För mig som forskare är det fascinerande. Som person kan det vara mycket skrämmande och mycket oroande.

Vi använder spekulativa scenarier och designfiktion som en forskningsmetod. Men vi hänvisar inte till någon avlägsen framtid. I stället spekulerar vi på vad som är teknologiskt och socialt möjligt här och nu.

SN: Ditt papper presenterar tre imaginära, men problematiska, scenarier som kan uppstå med dessa dödsbotar. Vilket finner du mest dystopiskt?

Nowaczyk-Basińska: [I ett av våra scenarier], presenterar vi en kvinnligt terminalt cancerpatient som lämnar en sorgbot för att hjälpa sin åttaårige son genom sorgprocessen. Vi använder detta exempel eftersom vi tror att det kan vara mycket riskabelt att utsätta barn för denna teknik.

Jag tror att vi kan gå ännu längre och i nära framtid använda detta för att till och med dölja döden för ett barn av en förälder eller annan nära släkting. Och för närvarande vet vi mycket, mycket lite om hur dessa tekniker skulle påverka barn.

Vi hävdar att om vi inte kan bevisa att denna teknik inte kommer att vara skadlig, bör vi vidta alla möjliga åtgärder för att skydda de mest sårbara. Och i det här fallet skulle det betyda åldersbegränsad tillgång till dessa tekniker.

SN: Vilka andra säkerhetsåtgärder är viktiga?

Nowaczyk-Basińska: Vi bör se till att användaren är medveten om att de interagerar med AI. [Tekniken kan] simulera språkmönster och personlighetsdrag baserat på bearbetning av stora mängder personuppgifter. Men det är definitivt inte ett medvetet väsen. Vi förespråkar också utveckling av känsliga procedurer för att pensionera eller radera dödsbotar. Och vi betonar också betydelsen av samtycke.

SN: Kan du beskriva det scenario du föreställde dig som utforskar samtycke för bot-användaren?

Nowaczyk-Basińska: Vi presenterar en äldre person som i hemlighet - det är ett mycket viktigt ord, i hemlighet - förbinder sig till en dödsbot av sig själv, betalar för en 20-års prenumeration, i hopp om att det kommer att trösta deras vuxna barn. Och nu tänk er bara att efter begravningen får barnen en massa e-post, notifikationer eller uppdateringar från återskapningstjänsten, tillsammans med inbjudan att interagera med boten av deras avlidna far.

[Barnen] bör ha rätt att bestämma om de vill gå igenom sorgeprocessen på det här sättet eller inte. För vissa människor kan det vara tröstande och det kan vara till hjälp, men för andra inte.

SN: Ni argumenterar också för att det är viktigt att skydda människors värdighet, även efter döden. I ditt föreställda scenario om denna fråga använder en vuxen kvinna en gratistjänst för att skapa en dödsbot av sin sedan länge avlidna mormor. Vad händer härnäst?

Nowaczyk-Basińska: She asks the deadbot about the recipe for homemade carbonara spaghetti that she loved cooking with her grandmother. Instead of receiving the recipe, she receives a recommendation to order that food from a popular delivery service. Our concern is that griefbots might become a new space for a very sneaky product placement, encroaching upon the dignity of the deceased and disrespecting their memory.

SN: Different cultures have very different ways of handling death. How can safeguards take this into account?

Nowaczyk-Basińska: We are very much aware that there is no universal ethical framework that could be developed here. The topics of death, grief and immortality are hugely culturally sensitive. And solutions that might be enthusiastically adopted in one cultural context could be completely dismissed in another. This year, I started a new research project: I’m aiming to explore different perceptions of AI-enabled simulation of death in three different eastern nations, including Poland, India and probably China.

SN: Why is now the time to act on this?

Nowaczyk-Basińska: When we started working on this paper a year ago, we were a bit concerned whether it’s too [much like] science fiction. Now [it’s] 2024. And with the advent of large language models, especially ChatGPT, these technologies are more accessible. That’s why we so desperately need regulations and safeguards.

Re-creation service providers today are making totally arbitrary decisions of what is acceptable or not. And it’s a bit risky to let commercial entities decide how our digital death and digital immortality should be shaped. People who decide to use digital technologies in end-of-life situations are already in a very, very difficult point in their lives. We shouldn’t make it harder for them through irresponsible technology design.