Il nuovo modello di deep learning utilizza i video per misurare lo sviluppo embrionale

28 maggio 2024

Questo articolo è stato rivisto secondo il processo editoriale e le politiche di Science X. Gli editori hanno evidenziato i seguenti attributi garantendo contemporaneamente la credibilità del contenuto:

- verificato

- pubblicazione sottoposta a revisione paritaria

- fonte affidabile

- corretto

dall'Università di Plymouth

Una ricerca condotta dall'Università di Plymouth ha dimostrato che un nuovo modello di IA basato sull'apprendimento profondo può identificare ciò che accade e quando durante lo sviluppo embrionale, da un video.

Pubblicato sulla rivista Journal of Experimental Biology, lo studio, intitolato 'Dev-ResNet: Rilevamento automatico degli eventi dello sviluppo utilizzando l'apprendimento profondo', evidenzia come il modello, noto come Dev-ResNet, possa identificare l'occorrenza di importanti eventi di sviluppo funzionale nei lumache d'acqua, incluso la funzione cardiaca, lo strisciare, la schiusa e persino la morte.

Un'innovazione chiave di questo studio è l'uso di un modello 3D che utilizza i cambiamenti avvenuti tra le inquadrature del video e che permette all'IA di apprendere da queste caratteristiche, al contrario dell'uso più tradizionale di immagini statiche.

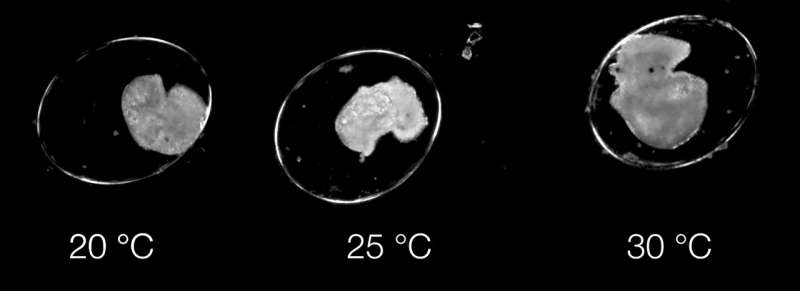

L'uso del video significa che caratteristiche che vanno dal primo battito cardiaco, o comportamento dello strisciare, fino alla formazione del guscio o alla schiusa vengono rilevate in modo affidabile da Dev-ResNet, e ha rivelato sensibilità di diverse caratteristiche alla temperatura non precedentemente note.

Sebbene utilizzato nelle lumachine d'acqua per questo studio, gli autori affermano che il modello ha una vasta applicabilità in tutte le specie, e forniscono script completi e documentazione per l'applicazione di Dev-ResNet in diversi sistemi biologici.

In futuro, la tecnica potrebbe essere utilizzata per aiutare ad accelerare la comprensione di come i cambiamenti climatici, e altri fattori esterni, influenzano gli esseri umani e gli animali.

Il lavoro è stato guidato dal candidato al dottorato, Ziad Ibbini, che ha studiato Biologia della Conservazione presso l'Università, prima di prendere un anno di pausa per migliorare le sue competenze nello sviluppo di software, poi ha iniziato il suo dottorato. Ha progettato, addestrato e testato Dev-ResNet da solo.

Ha detto, 'Delineare gli eventi dello sviluppo - o capire cosa succede quando nello sviluppo precoce di un animale - è molto impegnativo, ma incredibilmente importante perché ci aiuta a comprendere i cambiamenti nel momento in cui avvengono gli eventi tra le specie e gli ambienti.

'Dev-ResNet è una piccola ed efficiente rete neurale convoluzionale 3D in grado di rilevare eventi dello sviluppo utilizzando video, e può essere addestrata in modo relativamente semplice su hardware di consumo.

'Le uniche vere limitazioni sono nella creazione dei dati per addestrare il modello di deep learning - sappiamo che funziona, basta fornirgli i dati di addestramento corretti.

'Vogliamo dotare l'intera comunità scientifica degli strumenti che le permetteranno di capire meglio come lo sviluppo di una specie è influenzato da diversi fattori, e quindi identificare come possiamo proteggerli. Pensiamo che Dev-ResNet sia un passo significativo in quella direzione.'

Il Dr. Oli Tills, autore senior dell'articolo e UKRI Future Leaders Research Fellow, ha aggiunto, 'Questa ricerca è importante a livello tecnologico, ma è anche significativa per far avanzare il modo in cui percepiamo lo sviluppo degli organismi - qualcosa che l'Università di Plymouth, all'interno del Gruppo di Ricerca sull'Ecologia e lo Sviluppo, ha più di 20 anni di storia nella ricerca.'

'Questo traguardo non sarebbe stato possibile senza l'apprendimento profondo, ed è eccitante pensare a dove questa nuova capacità ci porterà nello studio degli animali durante il loro periodo di vita più dinamico.'

Informazioni sulla rivista: Journal of Experimental Biology

Fornito dall'Università di Plymouth