Nuevo modelo de aprendizaje profundo utiliza video para medir el desarrollo embrionario

28 de mayo de 2024

Este artículo ha sido revisado de acuerdo con el proceso y políticas editoriales de Science X. Los editores han destacado los siguientes atributos mientras aseguran la credibilidad del contenido:

- verificado

- publicación revisada por pares

- fuente de confianza

- corregido

por la Universidad de Plymouth

Una investigación liderada por la Universidad de Plymouth ha demostrado que un nuevo modelo de IA de aprendizaje profundo puede identificar qué sucede y cuándo durante el desarrollo embrionario, a partir de un vídeo.

Publicado en la Journal of Experimental Biology, el estudio, titulado 'Dev-ResNet: Detección automatizada de eventos de desarrollo usando aprendizaje profundo', destaca cómo el modelo, conocido como Dev-ResNet, puede identificar la ocurrencia de eventos de desarrollo funcional clave en caracoles de estanque, incluyendo la función del corazón, el desplazamiento, la eclosión e incluso la muerte.

Una innovación clave en este estudio es el uso de un modelo 3D que utiliza cambios que ocurren entre los fotogramas del video, y permite a la IA aprender de estas características, en oposición al uso más tradicional de imágenes fijas.

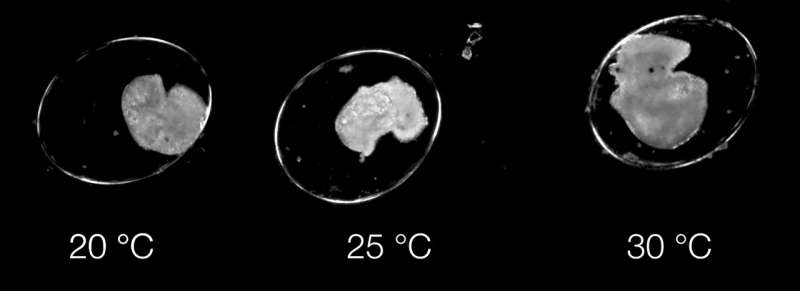

El uso de video significa que características que van desde el primer latido del corazón o el comportamiento de arrastre, hasta la formación de la concha o la eclosión son detectadas de manera confiable por Dev-ResNet, y ha revelado sensibilidades de diferentes características a la temperatura que no se conocían previamente.

Aunque se utilizó en embriones de caracoles de estanque para este estudio, los autores dicen que el modelo tiene una amplia aplicabilidad en todas las especies, y proporcionan guiones completos y documentación para aplicar Dev-ResNet en diferentes sistemas biológicos.

En el futuro, la técnica podría usarse para ayudar a acelerar la comprensión de cómo el cambio climático, y otros factores externos, afectan a los humanos y a los animales.

El trabajo fue liderado por el candidato a doctorado, Ziad Ibbini, quien estudió la Licenciatura en Biología de la Conservación en la Universidad, antes de tomarse un año sabático para adquirir habilidades en desarrollo de software, y luego comenzar su doctorado. Diseñó, entrenó y probó Dev-ResNet él mismo.

Él dijo: 'Delinear los eventos de desarrollo, o descubrir qué pasa y cuándo en el desarrollo temprano de un animal, es tan desafiante pero increíblemente importante, ya que nos ayuda a entender los cambios en el tiempo de los eventos entre las especies y los ambientes.

'Dev-ResNet es una pequeña y eficiente red neuronal convolucional 3D capaz de detectar eventos de desarrollo usando videos, y puede ser entrenada relativamente fácilmente en hardware de consumo.

'Las únicas limitaciones reales están en la creación de los datos para entrenar el modelo de aprendizaje profundo, sabemos que funciona, solo tienes que proporcionarle los datos de entrenamiento correctos.

'Queremos dotar a la comunidad científica con las herramientas que les permitan entender mejor cómo el desarrollo de una especie se ve afectado por diferentes factores, y así identificar cómo podemos protegerles. Creemos que Dev-ResNet es un paso significativo en esa dirección.'

El Dr. Oli Tills, autor principal del artículo y miembro de la Investigación de Futuros Líderes del UKRI, agregó: 'Esta investigación es importante a nivel tecnológico, pero también lo es para avanzar en cómo percibimos el desarrollo de los organismos, algo que la Universidad de Plymouth, dentro del Grupo de Investigación Ecophysiology and Development, tiene más de 20 años de historia investigando.

'Este hito no habría sido posible sin el aprendizaje profundo, y es emocionante pensar a dónde nos llevará esta nueva capacidad en el estudio de los animales durante su período más dinámico de la vida.'

Información del diario: Journal of Experimental Biology

Proporcionado por la Universidad de Plymouth