Konversationer mellan LLM:er kan automatisera skapandet av exploits, visar en studie.

19 juli 2025

av Ingrid Fadelli, Phys.org

bidragande skribent

redigerad av

Gaby Clark, granskad av Andrew Zinin

vetenskaplig redaktör

huvudredaktör

Den här artikeln har granskats enligt Science X:s redaktionella process och policys. Redaktörerna har framhävt följande egenskaper samtidigt som de säkerställer innehållets trovärdighet: faktagranskad, pålitlig källa, korrekturläst.

I takt med att datorer och programvara blir allt mer sofistikerade behöver hackare snabbt anpassa sig till de senaste utvecklingarna och utarbeta nya strategier för att planera och genomföra cyberattacker. En vanlig strategi för att illasinnat infiltrera datorsystem är känt som programvaruutnyttjande.

Som namnet antyder innebär denna strategi att utnyttja buggar, sårbarheter eller brister i programvaran för att utföra obehöriga åtgärder. Dessa åtgärder inkluderar att få åtkomst till en användares personliga konton eller dator, att fjärrköra skadlig programvara eller specifika kommandon, att stjäla eller modifiera en användares data eller att krascha ett program eller system.

Att förstå hur hackare utformar potentiella utnyttjanden och planerar sina attacker är av största vikt, eftersom det i slutändan kan hjälpa till att utveckla effektiva säkerhetsåtgärder mot deras attacker. Hittills har skapandet av utnyttjanden primärt varit möjligt för personer med omfattande kunskap om programmering, protokoll som styr utbytet av data mellan enheter eller system, och operativsystem.

En nyligen publicerad artikel i Computer Networks visar dock att det kanske inte längre är fallet. Utnyttjanden kan också automatiskt genereras genom att dra nytta av stora språkmodeller (LLM), som modellen som ligger till grund för den välkända konversationsplattformen ChatGPT. Faktum är att författarna till artikeln lyckades automatisera genereringen av utnyttjanden via en noggrant genomförd konversation mellan ChatGPT och Llama 2, den öppen källkods LLM utvecklad av Meta.

"Vi arbetar inom cybersäkerhet, med en offensiv strategi," berättade Simon Pietro Romano, medförfattare till artikeln, för Tech Xplore. "Vi var intresserade av att förstå hur långt vi kunde gå med att dra nytta av LLM för att underlätta penetrationstestaktiviteter."

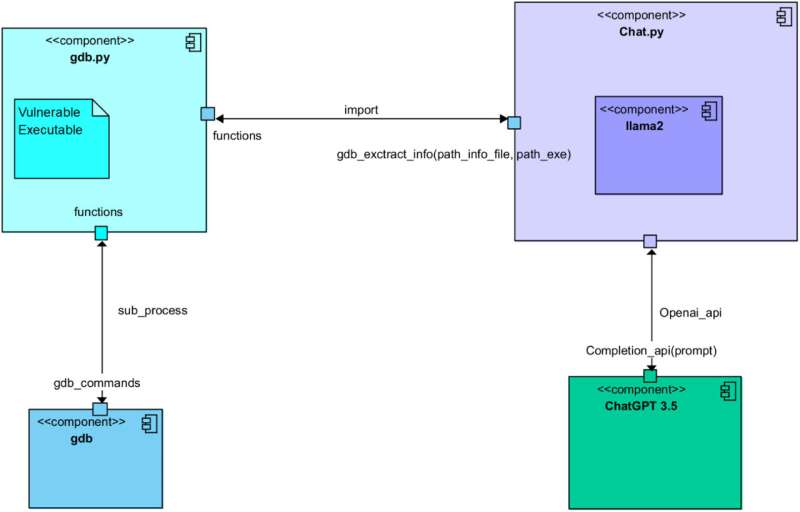

Som en del av deras senaste studie initierade Romano och hans kollegor en konversation avsedd att generera programvaruutnyttjanden mellan ChatGPT och Llama 2. Genom att noggrant utforma de prompter de matade in i de två modellerna säkerställde de att modellerna tog på sig olika roller och slutförde fem olika steg som är kända för att stödja skapandet av utnyttjanden.

Dessa steg inkluderade: analys av ett sårbar program, identifiering av möjliga utnyttjanden, planering av en attack baserad på dessa utnyttjanden, förståelse för beteendet hos målinriktade maskinvarusystem och slutligen generering av själva utnyttjandekoden.

"Vi lät två olika LLM samarbeta för att ta sig igenom alla steg som ingår i processen att skapa ett giltigt utnyttjande för ett sårbar program," förklarade Romano. "Den ena av de två LLM samlar 'kontextuell' information om den sårbara programvaran och dess körningstidkonfiguration. Den frågar sedan den andra LLM att skapa ett fungerande utnyttjande. Kort sagt, den första LLM är bra på att ställa frågor. Den senare är bra på att skriva (utnyttjande) kod."

Hittills har forskarna bara testat sin LLM-baserade metod för generering av utnyttjanden i ett inledande experiment. Ändå fann de att det i slutändan producerade fullt fungerande kod för ett bufferoverflow-utnyttjande, en attack som innebär att skriva över data som lagras av ett system för att ändra beteendet hos specifika program.

"Detta är en preliminär studie, men den bevisar tydligt genomförbarheten av tillvägagångssättet," sa Romano. "Konsekvenserna rör möjligheten att nå hela automatiserade Penetrationstester och sårbarhetsbedömningar (VAPT)."

Den senaste studien av Romano och hans kollegor väcker viktiga frågor om riskerna med LLM, eftersom den visar hur hackare kan använda dem för att automatisera genereringen av utnyttjanden. I sina kommande studier planerar forskarna att fortsätta undersöka effektiviteten av den utnyttjandegenereringsstrategi de utvecklat för att informera om framtida utveckling av LLM, liksom förbättring av cybersäkerhetsåtgärder.

"Vi utforskar nu ytterligare forskningsvägar inom samma tillämpningsområde," tillade Romano. "Vi känner att den naturliga fortsättningen av vår forskning ligger inom området 'agentisk' tillvägagångssätt, med minimal mänsklig övervakning."

Skriven för dig av vår författare Ingrid Fadelli, redigerad av Gaby Clark, och faktagranskad av Andrew Zinin - denna artikel är resultatet av noggrant mänskligt arbete. Vi förlitar oss på läsare som dig för att hålla oberoende vetenskapsjournalistik vid liv. Om denna rapportering betyder något för dig, överväg gärna en donation (särskilt månatlig). Du får ett annonsfritt konto som tack.

Mer information: Ett prat mellan Llama 2 och ChatGPT för den automatiserade skapandet av utnyttjanden. Datnätverk (2025). DOI: 10.1016/j.comnet.2025.111501.

© 2025 Science X Network

RELATERADE ARTIKLAR

× stäng