Elastyczne obliczenia wielozadaniowe w sieciach neuronowych rekurencyjnych opierają się na motywach dynamicznych, jak pokazuje badanie

16 sierpnia 2024 funkcja

Ten artykuł został przejrzany zgodnie z procesem redakcyjnym i zasadami Science X. Redaktorzy podkreślili następujące cechy, dbając jednocześnie o wiarygodność treści:

- sprawdzane pod kątem faktów

- publikacja przejrzana przez recenzentów

- zaufane źródło

- skorygowane

przez Ingrid Fadelli , Tech Xplore

Elastyczność poznawcza, czyli zdolność do szybkiego przełączania się między różnymi myślami i koncepcjami mentalnymi, jest bardzo korzystną ludzką umiejętnością. Ta istotna zdolność wspiera wielozadaniowość, szybkie zdobywanie nowych umiejętności oraz adaptację do nowych sytuacji.

Podczas gdy systemy sztucznej inteligencji (AI) stały się coraz bardziej zaawansowane w ciągu ostatnich kilku dziesięcioleci, obecnie nie wykazują one tej samej elastyczności co ludzie w uczeniu się nowych umiejętności i przełączaniu się między zadaniami. Lepsze zrozumienie tego, w jaki sposób biologiczne obwody nerwowe wspierają elastyczność poznawczą, zwłaszcza wielozadaniowość, mogłoby pomóc w przyszłych wysiłkach mających na celu opracowanie bardziej elastycznej AI.

Ostatnio niektórzy informatycy i neurobiolodzy badali obliczenia neuronalne przy użyciu sztucznych sieci neuronowych. Większość tych sieci jednak była ogólnie szkolona do rozwiązywania określonych zadań indywidualnie, a nie wielu zadań jednocześnie.

W 2019 roku grupa badawcza z Uniwersytetu w Nowym Jorku, Uniwersytetu Columbia i Uniwersytetu Stanfordu szkoliła pojedynczą sieć neuronową do wykonywania 20 powiązanych zadań.

W nowym artykule opublikowanym w czasopiśmie Nature Neuroscience zespół z Uniwersytetu Stanford postanowił zbadać, co pozwala tej sieci neuronowej na wykonywanie modułowych obliczeń, radząc sobie z kilkoma różnymi zadaniami.

'Elastyczne obliczenia to cecha inteligentnego zachowania,' napisali Laura N. Driscoll, Krishna Shenoy i David Sussillo w swoim artykule. 'Jednak niewiele wiadomo na temat tego, jak sieci neuronalne przystosowują kontekstualnie do różnych obliczeń. W niniejszej pracy zidentyfikowaliśmy algorytmiczny substrat neuronalny dla modułowych obliczeń poprzez badanie sieci wielozadaniowych sztucznych sieci rekurencyjnych.'

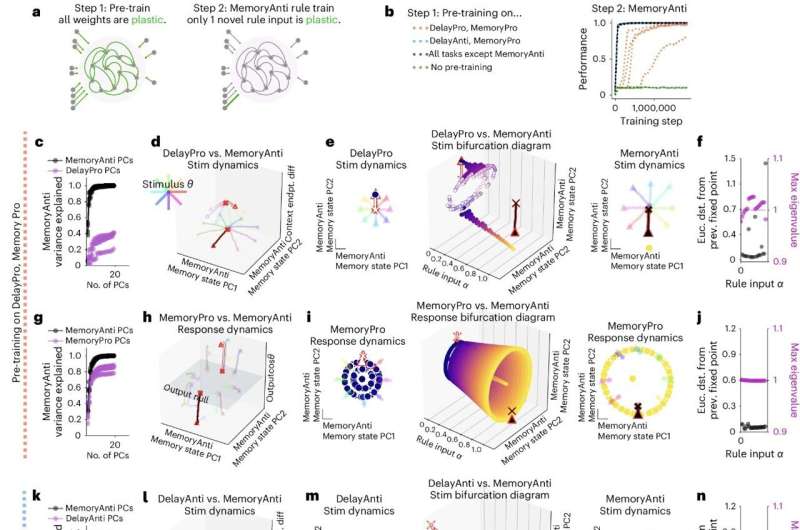

Głównym celem niedawnych badań Driscoll, Shenoy i Sussillo było zbadanie mechanizmów leżących u podstaw obliczeń sieci neuronowych z powtarzającymi się połączeniami rekurencyjnymi. Ich wysiłki pozwoliły badaczom zidentyfikować substrat obliczeniowy tych sieci, który umożliwia modułowe obliczenia, substrat nazwany przez nich 'motywami dynamicznymi.'

'Analizy systemów dynamicznych ujawniły nauczone strategie obliczeń odzwierciedlające modularną strukturę podzadaniu zestawu zadań szkoleniowych,' napisali Driscoll, Shenoy i Sussillo. 'Motywy dynamiczne, czyli powtarzające się wzorce aktywności neuronalnej implementujące konkretne obliczenia poprzez dynamikę, takie jak atraktory, granice decyzyjne i rotacje, były wykorzystywane w różnych zadaniach. Na przykład zadania wymagające pamięci ciągłej zmiennej kołowej wykorzystały ten sam atraktor pierścienia.'

Badacze przeprowadzili szereg analiz, które ujawniły, że w sieciach neuronowych konwolucyjnych, tzw. motywy dynamiczne są implementowane przez skupiska jednostek, gdy funkcja aktywacji jednostki jest ograniczona do wartości pozytywnych. Ponadto, uszkodzenia tych jednostek okazały się niekorzystne dla zdolności sieci do wykonywania modułowych obliczeń.

'Motywy były ponownie konfigurowane dla szybkiego uczenia się transferowego po początkowej fazie uczenia,' napisali Driscoll, Shenoy i Sussillo. 'Ta praca ustanawia motywy dynamiczne jako fundamentalną jednostkę kompozycyjnych obliczeń, pośrednią między neuronem a siecią. Ponieważ badania całego mózgu jednocześnie rejestrują aktywność z wielu specjalizowanych systemów, ramy motywów dynamicznych będą prowadzić do pytań o specjalizację i generalizację.'

Ogólnie, najnowsze badania tego zespołu badaczy wskazują substrat sieci neuronowych konwolucyjnych, który znacząco przyczynia się do ich zdolności do skutecznego radzenia sobie z wieloma zadaniami. W przyszłości wyniki tej pracy mogą przyczynić się zarówno do badań w zakresie neurobiologii, jak i informatyki, potencjalnie prowadząc do lepszego zrozumienia procesów neuronalnych leżących u podstaw elastyczności poznawczej oraz inspirując rozwój nowych strategii, które naśladują te procesy w sztucznych sieciach neuronowych.

Więcej informacji: Laura N. Driscoll et al, Flexible multitask computation in recurrent networks utilizes shared dynamical motifs, Nature Neuroscience (2024). DOI: 10.1038/s41593-024-01668-6

© 2024 Science X Network