Flexible Multi-Task-Berechnung in wiederkehrenden neuronalen Netzen basiert auf dynamischen Motiven, wie eine Studie zeigt.

16. August 2024 feature

Dieser Artikel wurde gemäß des Redaktionsprozesses und der Richtlinien von Science X überprüft. Die Herausgeber haben die folgenden Merkmale hervorgehoben, um die Glaubwürdigkeit des Inhalts sicherzustellen:

- faktengestützt

- peer-reviewte Publikation

- vertrauenswürdige Quelle

- Lektorat

von Ingrid Fadelli, Tech Xplore

Kognitive Flexibilität, die Fähigkeit, schnell zwischen verschiedenen Gedanken und mentalen Konzepten zu wechseln, ist eine äußerst vorteilhafte menschliche Fähigkeit. Diese wichtige Fähigkeit unterstützt Multitasking, den schnellen Erwerb neuer Fähigkeiten und die Anpassung an neue Situationen.

Obwohl künstliche Intelligenz (KI)-Systeme in den letzten Jahrzehnten immer ausgefeilter geworden sind, zeigen sie derzeit nicht die gleiche Flexibilität wie Menschen beim Erlernen neuer Fähigkeiten und dem Wechsel zwischen Aufgaben. Ein besseres Verständnis dafür, wie biologische neuronale Schaltkreise die kognitive Flexibilität unterstützen, insbesondere wie sie Multitasking unterstützen, könnte künftige Bemühungen zur Entwicklung flexiblerer KI informieren.

In letzter Zeit haben einige Informatiker und Neurowissenschaftler neuronale Berechnungen mithilfe künstlicher neuronaler Netze untersucht. Die meisten dieser Netze wurden jedoch im Allgemeinen darauf trainiert, spezifische Aufgaben individuell anstatt mehrere Aufgaben zu bewältigen.

Im Jahr 2019 trainierte eine Forschungsgruppe an der New York University, der Columbia University und der Stanford University ein einziges neuronales Netzwerk, um 20 verwandte Aufgaben auszuführen.

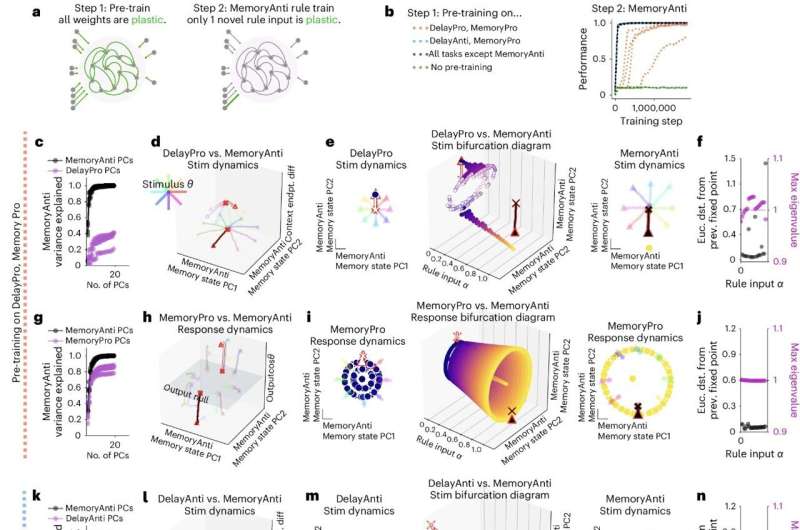

In einem neuen Artikel, der in Nature Neuroscience veröffentlicht wurde, untersuchte ein Team an der Stanford-Universität, was es diesem neuronalen Netzwerk ermöglicht, modulare Berechnungen durchzuführen und damit mehrere verschiedene Aufgaben zu bewältigen.

"Flexible Berechnung ist ein Merkmal intelligenten Verhaltens", schrieben Laura N. Driscoll, Krishna Shenoy und David Sussillo in ihrem Artikel. "Jedoch ist wenig darüber bekannt, wie neuronale Netzwerke sich kontextuell für verschiedene Berechnungen neu konfigurieren. In der vorliegenden Arbeit haben wir ein algorithmisches neurales Substrat für modulare Berechnungen durch die Untersuchung von multita... und Informationen zur Entwicklung neuer Strategien, die diese Prozesse in künstlichen neuronalen Netzen nachahmen könnten.

Weitere Informationen: Laura N. Driscoll et al, Flexible multitask computation in recurrent networks utilizes shared dynamical motifs, Nature Neuroscience (2024). DOI: 10.1038/s41593-024-01668-6

© 2024 Science X Network