La computación multitarea flexible en redes neuronales recurrentes se basa en motivos dinámicos, muestra un estudio

16 de agosto de 2024 característica

Este artículo ha sido revisado de acuerdo con el proceso editorial y políticas de Science X. Los editores han destacado los siguientes atributos mientras aseguran la credibilidad del contenido:

- verificado

- publicación revisada por pares

- fuente confiable

- corregido

por Ingrid Fadelli, Tech Xplore

La flexibilidad cognitiva, la capacidad de cambiar rápidamente entre diferentes pensamientos y conceptos mentales, es una capacidad humana altamente ventajosa. Esta destacada capacidad apoya la multitarea, la rápida adquisición de nuevas habilidades y la adaptación a nuevas situaciones.

Aunque los sistemas de inteligencia artificial (IA) se han vuelto cada vez más avanzados en las últimas décadas, actualmente no muestran la misma flexibilidad que los humanos para aprender nuevas habilidades y cambiar entre tareas. Una mejor comprensión de cómo los circuitos neurales biológicos respaldan la flexibilidad cognitiva, especialmente cómo respaldan la multitarea, podría informar los esfuerzos futuros destinados a desarrollar IA más flexible.

Recientemente, algunos científicos de la computación y neurocientíficos han estado estudiando las computaciones neurales usando redes neuronales artificiales. Sin embargo, la mayoría de estas redes generalmente fueron entrenadas para abordar tareas específicas individualmente en lugar de varias tareas.

En 2019, un grupo de investigación en la Universidad de Nueva York, la Universidad de Columbia y la Universidad de Stanford entrenó a una sola red neuronal para realizar 20 tareas relacionadas.

En un nuevo artículo publicado en Nature Neuroscience, un equipo en Stanford se propuso investigar qué permite a esta red neuronal realizar cálculos modulares, abordando así varias tareas diferentes.

'La computación flexible es una característica del comportamiento inteligente,' escribieron Laura N. Driscoll, Krishna Shenoy y David Sussillo en su artículo. 'Sin embargo, se sabe poco sobre cómo las redes neuronales se reconfiguran contextualmente para diferentes cálculos. En este trabajo, identificamos un sustrato neural algorítmico para la computación modular a través del estudio de redes neuronales recurrentes artificiales multitarea.'

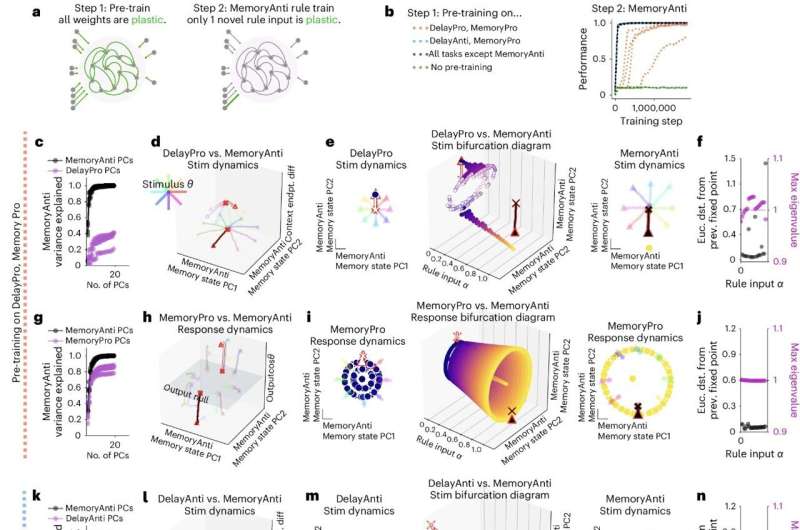

El objetivo principal del estudio reciente de Driscoll, Shenoy y Sussillo fue investigar los mecanismos subyacentes en los cálculos de redes neuronales artificiales recurrentemente conectadas. Sus esfuerzos permitieron a los investigadores identificar un sustrato computacional de estas redes que permite cálculos modulares, un sustrato que describen con el término 'motivos dinámicos'.

'Los análisis de sistemas dinámicos revelaron estrategias computacionales aprendidas que reflejan la estructura de sub-tareas modulares del conjunto de tareas de entrenamiento,' escribieron Driscoll, Shenoy y Sussillo. 'Los motivos dinámicos, que son patrones recurrentes de actividad neural que implementan cálculos específicos a través de la dinámica, como atractores, límites de decisión y rotaciones, se reutilizaron en las tareas. Por ejemplo, las tareas que requieren memoria de una variable circular continua repurpieron el mismo atractor de anillo.'

Los investigadores realizaron una serie de análisis, que revelaron que en redes neuronales convolucionales, los llamados motivos dinámicos se implementan mediante grupos de unidades cuando la función de activación de la unidad está restringida a ser positiva. Además, se descubrió que las lesiones en estas unidades afectaban negativamente la capacidad de las redes para realizar cálculos modulares.

'Los motivos se reconfiguraron para un aprendizaje rápido por transferencia después de una fase inicial de aprendizaje,' escribieron Driscoll, Shenoy y Sussillo. 'Este trabajo establece los motivos dinámicos como una unidad fundamental de cálculo composicional, intermedia entre la neurona y la red. A medida que los estudios de todo el cerebro registran simultáneamente la actividad de múltiples sistemas especializados, el marco de trabajo de motivos dinámicos guiará las preguntas sobre especialización y generalización.'

En general, el estudio reciente de este equipo de investigadores señala un sustrato de redes neuronales convolucionales que contribuye significativamente a su capacidad para abordar efectivamente múltiples tareas. En el futuro, los hallazgos de este trabajo podrían informar tanto la investigación en neurociencia como en informática, lo que potencialmente llevaría a una mejor comprensión de los procesos neuronales subyacentes a la flexibilidad cognitiva y a la formulación de nuevas estrategias que emulen estos procesos en redes neuronales artificiales.

Más información: Laura N. Driscoll et al, Flexible multitask computation in recurrent networks utilizes shared dynamical motifs, Nature Neuroscience (2024). DOI: 10.1038/s41593-024-01668-6

©2024 Science X Network