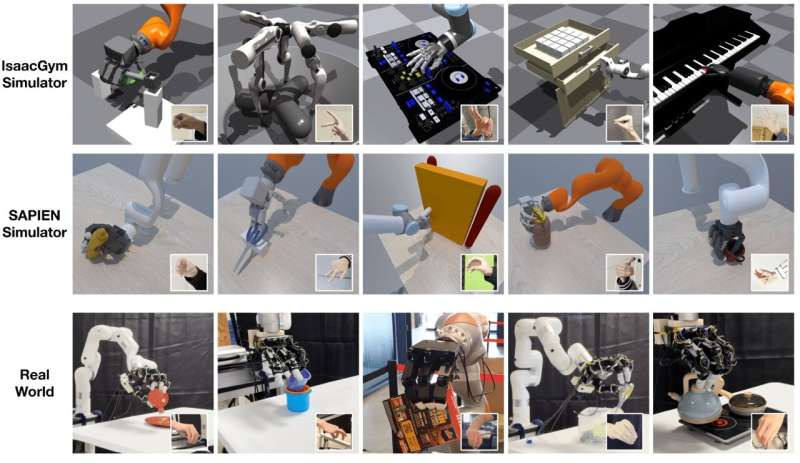

Un sistema de teleoperación basado en la visión por computadora que se puede aplicar a diferentes robots.

1 de agosto de 2023 feature

Este artículo ha sido revisado de acuerdo con el proceso editorial y políticas de Science X. Los editores han destacado los siguientes atributos al garantizar la credibilidad del contenido:

- fact-checked

- preprint

- fuente confiable

- corrección de pruebas

por Ingrid Fadelli, Tech Xplore

Los avances recientes en los campos de la robótica e inteligencia artificial (IA) han abierto nuevos caminos emocionantes para la teleoperación, el control remoto de robots para completar tareas en una ubicación remota. Esto podría, por ejemplo, permitir a los usuarios visitar museos desde lejos, completar tareas de mantenimiento o técnicas en espacios de difícil acceso o asistir a eventos de forma remota de manera más interactiva.

La mayoría de los sistemas de teleoperación existentes están diseñados para ser implementados en entornos específicos y utilizando un robot específico. Esto dificulta su aplicación en diferentes entornos del mundo real, limitando en gran medida su potencial.

Investigadores de NVIDIA y UC San Diego crearon recientemente AnyTeleop, un sistema de teleoperación basado en visión por computadora que se podría aplicar a una gama más amplia de escenarios. AnyTeleop, presentado en un artículo prepublicado en arXiv, permite la operación remota de diversos brazos y manos robóticas para abordar diferentes tareas manuales.

'Un objetivo principal en NVIDIA es investigar cómo los humanos pueden enseñar a los robots a realizar tareas', dijo Dieter Fox, director senior de investigación en robótica en NVIDIA, jefe del Laboratorio de Investigación en Robótica de NVIDIA, profesor en la Escuela de Ciencias de la Computación e Ingeniería Paul G. Allen de la Universidad de Washington y jefe del Laboratorio de Estimación de Estado y Robótica de la UW, a Tech Xplore.

'Los trabajos anteriores se han centrado en cómo un humano teleoperará o guiará al robot, pero este enfoque tiene dos barreras. Primero, entrenar un modelo de última generación requiere muchas demostraciones. Segundo, las configuraciones suelen presentar un aparato costoso o hardware sensorial y están diseñadas solo para un robot o entorno de implementación específico', dijo Fox.

El objetivo principal del trabajo reciente de Fox y sus colegas fue crear un sistema de teleoperación que sea de bajo costo, fácil de implementar y se generalice bien en diferentes tareas, entornos y sistemas robóticos. Para entrenar su sistema, los investigadores teleoperaron tanto robots virtuales en entornos simulados como robots reales en un entorno físico, lo que redujo la necesidad de comprar y ensamblar muchos robots.

'AnyTeleop es un sistema de teleoperación basado en visión que permite a los humanos usar sus manos para controlar sistemas robóticos manuales y de brazo', explicó Fox. 'El sistema rastrea las poses de la mano humana desde una o varias cámaras y luego las redirige para controlar los dedos de una mano robótica de varios dedos. El punto de la muñeca se utiliza para controlar el movimiento del brazo del robot con un planificador de movimiento impulsado por CUDA'.

En contraste con la mayoría de los otros sistemas de teleoperación presentados en estudios pasados, AnyTeleop se puede interfazar con brazos de robot diferentes, manos de robot, configuraciones de cámara y diferentes entornos simulados o del mundo real. Además, se puede aplicar a escenarios en los que los usuarios están cerca o en ubicaciones remotas.

La plataforma AnyTeleop también puede ayudar a recopilar datos de demostración humana (es decir, datos que representan los movimientos y acciones que los humanos realizan al ejecutar tareas manuales específicas). Estos datos podrían utilizarse a su vez para entrenar mejor a los robots para que completen diferentes tareas de manera autónoma.

'El avance principal de AnyTeleop es su diseño generalizable y fácil de implementar', dijo Fox. 'Una aplicación potencial es implementar entornos virtuales y robots virtuales en la nube, lo que permite que los usuarios con computadoras y cámaras de nivel básico (como un iPhone o una PC) los teleoperen. Esto podría revolucionar en última instancia el flujo de datos para investigadores y desarrolladores industriales que enseñan nuevas habilidades a los robots'.

En pruebas iniciales, se descubrió que AnyTeleop superaba a un sistema de teleoperación existente diseñado para un robot específico, incluso cuando se aplicaba a ese robot. Esto destaca su valor como herramienta para mejorar las aplicaciones de teleoperación.

NVIDIA pronto lanzará una versión de código abierto del sistema AnyTeleop, lo que permitirá a equipos de investigación de todo el mundo probarlo y aplicarlo a sus robots. En el futuro, esta nueva plataforma prometedora podría contribuir a la escalabilidad de los sistemas de teleoperación, al tiempo que facilita la recopilación de datos de entrenamiento para manipuladores robóticos.

'Ahora planeamos utilizar los datos recopilados para explorar más el aprendizaje de robots', agregó Fox. 'Un enfoque notable hacia el futuro es cómo superar las brechas de dominio al transferir modelos de robots de la simulación al mundo real'.

© 2023 Science X Network