Ein computervisionsbasiertes Teleoperationssystem, das auf verschiedene Roboter angewendet werden kann.

1. August 2023

Feature

Dieser Artikel wurde gemäß dem redaktionellen Prozess und den Richtlinien von Science X überprüft. Die Redakteure haben währenddessen folgende Merkmale hervorgehoben, um die Glaubwürdigkeit des Inhalts zu gewährleisten:

- Fact-Check

- Preprint

- Vertrauenswürdige Quelle

- Korrekturgelesen

Von Ingrid Fadelli, Tech Xplore

In den Bereichen Robotik und Künstliche Intelligenz (KI) haben die jüngsten Fortschritte aufregende neue Möglichkeiten für die Teleoperation eröffnet, d.h. die Fernsteuerung von Robotern zur Erfüllung von Aufgaben an einem entfernten Ort. Dies könnte den Benutzern beispielsweise ermöglichen, Museen aus der Ferne zu besuchen, Wartungs- oder technische Aufgaben in schwer zugänglichen Räumen durchzuführen oder Ereignisse auf interaktivere Weise remote zu besuchen.

Die meisten vorhandenen Teleoperationssysteme sind für den Einsatz in bestimmten Umgebungen und mit einem bestimmten Roboter konzipiert. Dies schränkt ihr Potenzial erheblich ein und macht es schwierig, sie in unterschiedlichen realen Umgebungen anzuwenden.

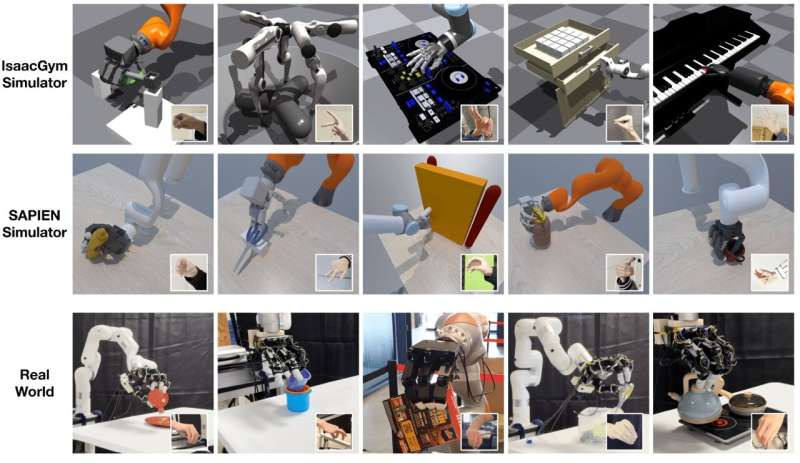

Forscher von NVIDIA und der UC San Diego haben kürzlich AnyTeleop entwickelt, ein auf Computervision basierendes Teleoperationssystem, das in einer breiteren Palette von Szenarien eingesetzt werden kann. AnyTeleop ermöglicht die Fernbedienung verschiedener Roboterarme und -hände zur Bewältigung unterschiedlicher manueller Aufgaben und wurde in einem auf arXiv vorveröffentlichten Artikel eingeführt.

'Ein primäres Ziel bei NVIDIA ist die Erforschung, wie Menschen Robotern beibringen können, Aufgaben auszuführen', sagte Dieter Fox, leitender Direktor der Robotikforschung bei NVIDIA, Leiter des NVIDIA Robotics Research Lab, Professor an der University of Washington Paul G. Allen School of Computer Science & Engineering und Leiter des UW Robotics and State Estimation Lab, gegenüber Tech Xplore.

'Bisherige Arbeiten konzentrierten sich darauf, wie ein Mensch den Roboter fernsteuern oder führen kann. Dieser Ansatz hat jedoch zwei Barrieren. Erstens erfordert das Training eines hochmodernen Modells viele Demonstrationen. Zweitens beinhalten Aufstellungen in der Regel teure Apparaturen oder Sensorhardware und sind nur auf einen bestimmten Roboter oder Einsatzbereich ausgelegt', so Fox.

Das Hauptziel der jüngsten Arbeiten von Fox und seinen Kollegen bestand darin, ein Teleoperationssystem zu entwickeln, das kostengünstig, einfach einzusetzen ist und sich für verschiedene Aufgaben, Umgebungen und Robotersysteme gut verallgemeinern lässt. Um ihr System zu trainieren, steuerten die Forscher sowohl virtuelle Roboter in simulierten Umgebungen als auch reale Roboter in einer physischen Umgebung, um den Kauf und die Zusammenstellung vieler Roboter zu reduzieren.

'AnyTeleop ist ein visionsbasiertes Teleoperationssystem, das es Menschen ermöglicht, ihre Hände zu verwenden, um dexteröse Roboterhand-Arm-Systeme zu steuern', erklärte Fox. 'Das System verfolgt die Handhaltungen des Menschen aus einer oder mehreren Kameras und überträgt sie dann auf die Finger einer mehrfingerigen Roboterhand. Der Handgelenkpunkt wird verwendet, um die Bewegung des Roboterarms mit einem CUDA-gestützten Bewegungsplaner zu steuern.'

Im Gegensatz zu den meisten anderen in früheren Studien vorgestellten Teleoperationssystemen kann AnyTeleop mit verschiedenen Roboterarmen, Roboterhänden, Kamerakonfigurationen und simulierten oder realen Umgebungen verbunden werden. Darüber hinaus kann es sowohl in Szenarien angewendet werden, in denen sich die Benutzer in der Nähe als auch an entfernten Orten befinden.

Die AnyTeleop-Plattform kann auch dazu beitragen, Schulungsdaten von menschlichen Demonstrationen zu sammeln (d.h. Daten, die die Bewegungen und Handlungen repräsentieren, die Menschen bei der Ausführung bestimmter manueller Aufgaben ausführen). Diese Daten könnten wiederum dazu verwendet werden, Roboter besser auf die eigenständige Ausführung verschiedener Aufgaben vorzubereiten.

'Der große Durchbruch von AnyTeleop liegt in seinem verallgemeinerbaren und leicht einsetzbaren Design', sagte Fox. 'Eine mögliche Anwendung besteht darin, virtuelle Umgebungen und virtuelle Roboter in der Cloud einzusetzen, sodass Edge-Benutzer mit Entry-Level-Computern und Kameras (wie einem iPhone oder PC) sie fernsteuern können. Dies könnte letztendlich die Datapipeline für Forscher und Industrieentwickler revolutionieren, um Robotern neue Fähigkeiten beizubringen.'

In ersten Tests konnte AnyTeleop sogar eine vorhandene Teleoperationssystem, das für einen bestimmten Roboter entwickelt wurde, übertreffen, wenn es auf diesen Roboter angewendet wurde. Dies unterstreicht seinen Wert als Werkzeug zur Verbesserung von Teleoperationsanwendungen.

NVIDIA wird in Kürze eine Open-Source-Version des AnyTeleop-Systems veröffentlichen, sodass Forschungsteams weltweit es testen und auf ihre Roboter anwenden können. In Zukunft könnte diese vielversprechende neue Plattform zur Skalierung von Teleoperationssystemen beitragen und gleichzeitig die Sammlung von Schulungsdaten für Roboter manipulatoren erleichtern.

'Wir planen nun, die gesammelten Daten zu nutzen, um das Roboterlernen weiter zu erforschen', fügte Fox hinzu. 'Ein besonderer Schwerpunkt liegt dabei auf der Überwindung von Domänengrenzen beim Übertragen von Robotermodellen von der Simulation in die reale Welt.'

© 2023 Science X Network